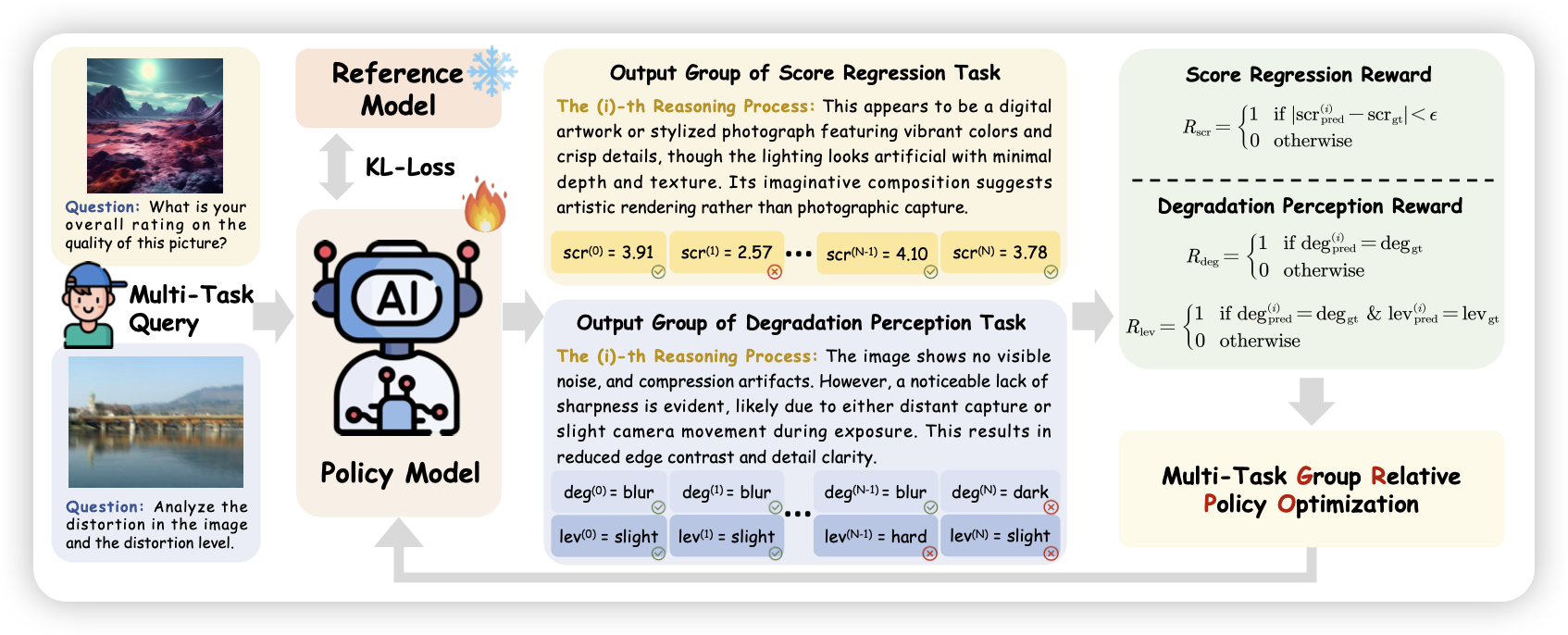

Q-Insight: Understanding Image Quality via Visual Reinforcement Learning

在vlm sft领域里,有一个重要的问题是image quality,基本上图片质量不行,训出来的vlm也是垃圾。大家一般的做法是,把坏的图片踢掉不出题。但是,如何找到差的图片呢?作者想到,如果在rl里把图片质量分类当成一个sft任务,和正常的sft数据一起训练,是不是就好了呢?作者发现这样训出来的模型在这两件事上都做的不错

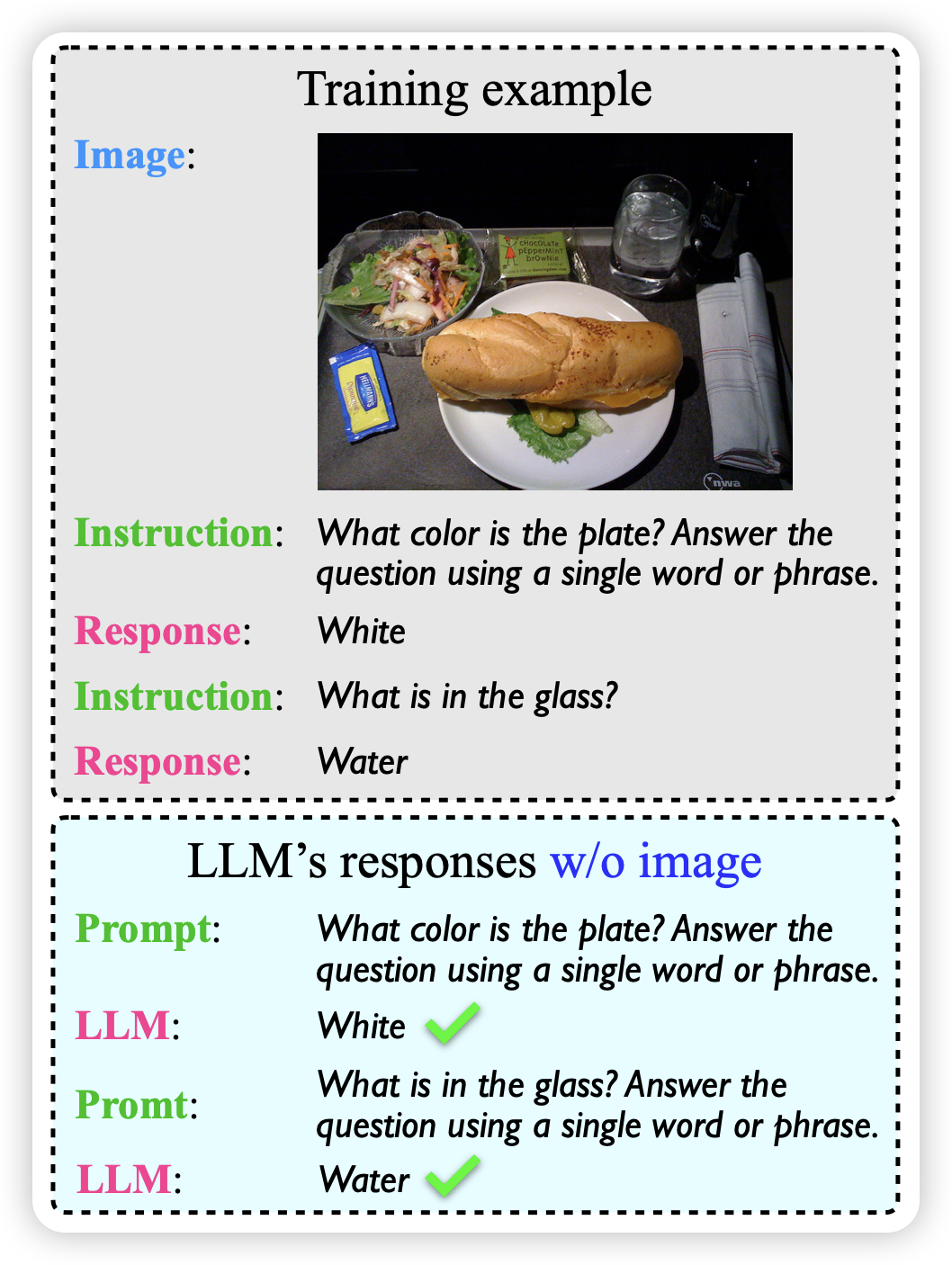

Learning to Instruct for Visual Instruction Tuning

之前看过一篇叫sq-llava的工作,讲在vlm sft数据里,对question加上loss,可以提分。那篇工作好像没火,今天又挂出来一篇类似的。作者认为,数据里的response信息其实有很多冗余,问题本身其实包含了图片的很多信息,所以学习提问是有意义的。

有没有人打算在大尺度下试试这个方案,我还挺好奇的