Train Long, Think Short: Curriculum Learning for Efficient Reasoning

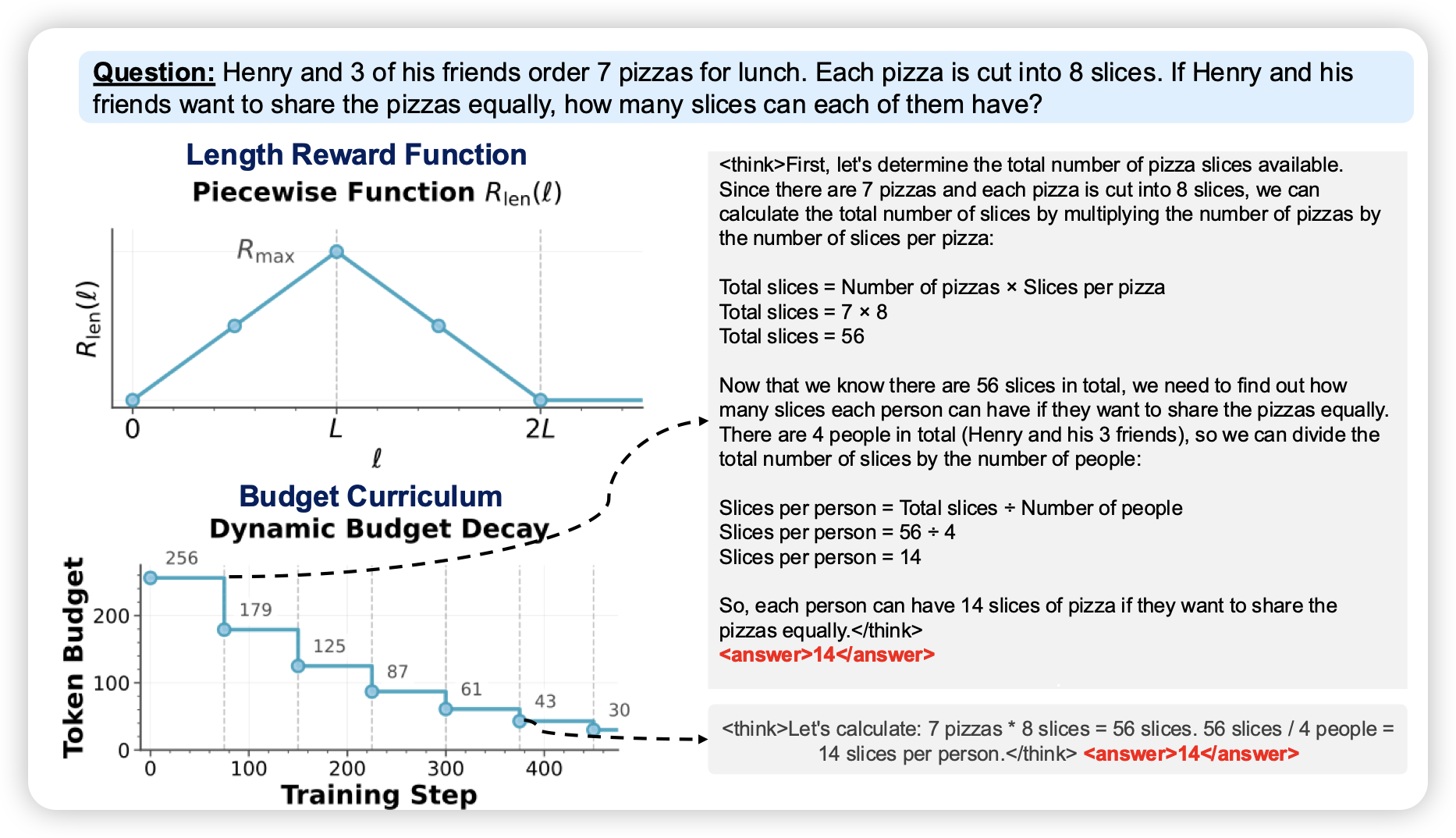

这篇工作比较有趣:作者发现,在rl过程中,先给大的thinking budget(允许每个题的think token数比较多),然后随着训练逐渐减少budget。比总体一直开着中等budget训练效果更好

这个结论相反的是,seed之前有个工作发现应该先给小budget,随着训练逐渐增大……这就是学术

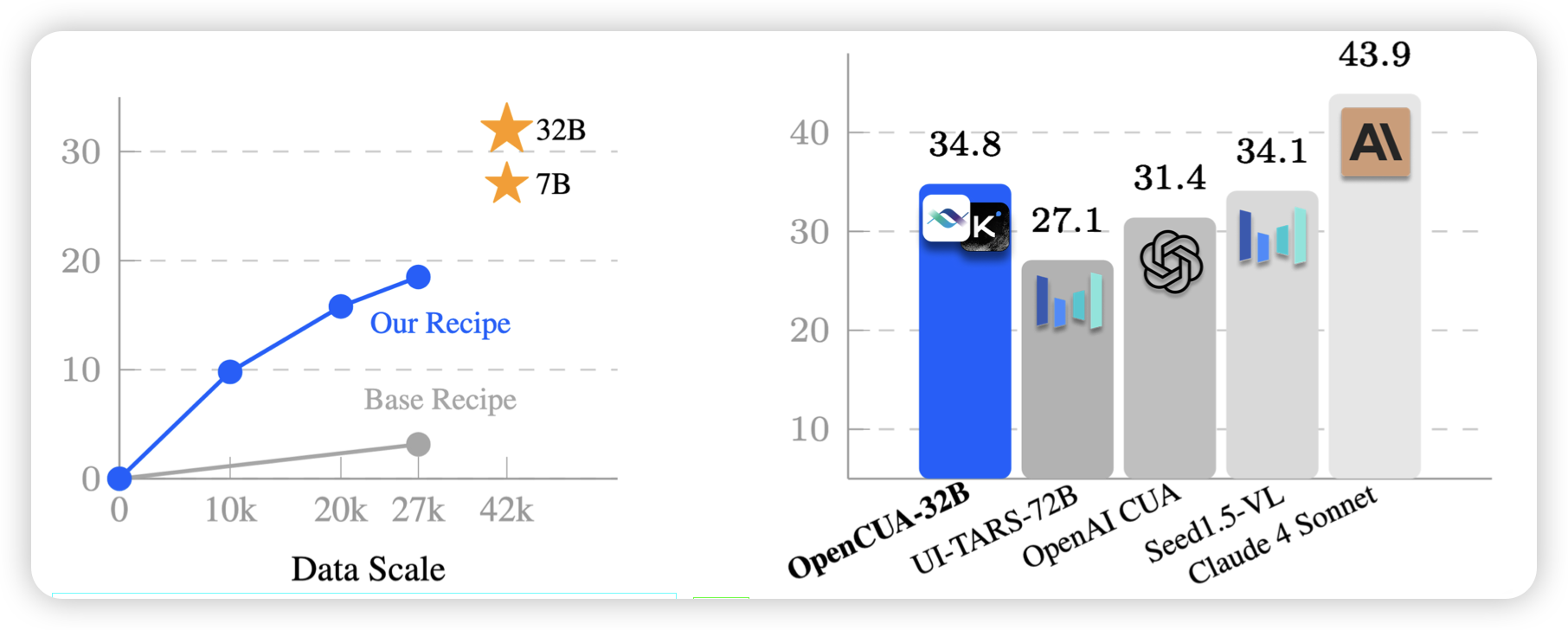

OPENCUA: Open Foundations for Computer-Use Agents

一篇很好的CUA工作,已经火了一段时间了,但是今天才挂出来。作者做了一个从数据集到模型都开源的框架,可以把osworld-verified做到35分。osworld verified是对osworld的评测脚本做了修复,排除了一些无法完成的题目。

之前的jedi数据集也是yutao老师组的工作,是单轮的grounding数据集,都是很好的工作