最近icml风格的无图论文多起来了

Eagle 2: Building Post-Training Data Strategies from Scratch for Frontier Vision-Language Models

nvidia出的vlm工作,作者这次比较良心,给出了训练数据的设计思路,和对于各种数据的消融实验结果。开源了模型

如果数据也开源的话……

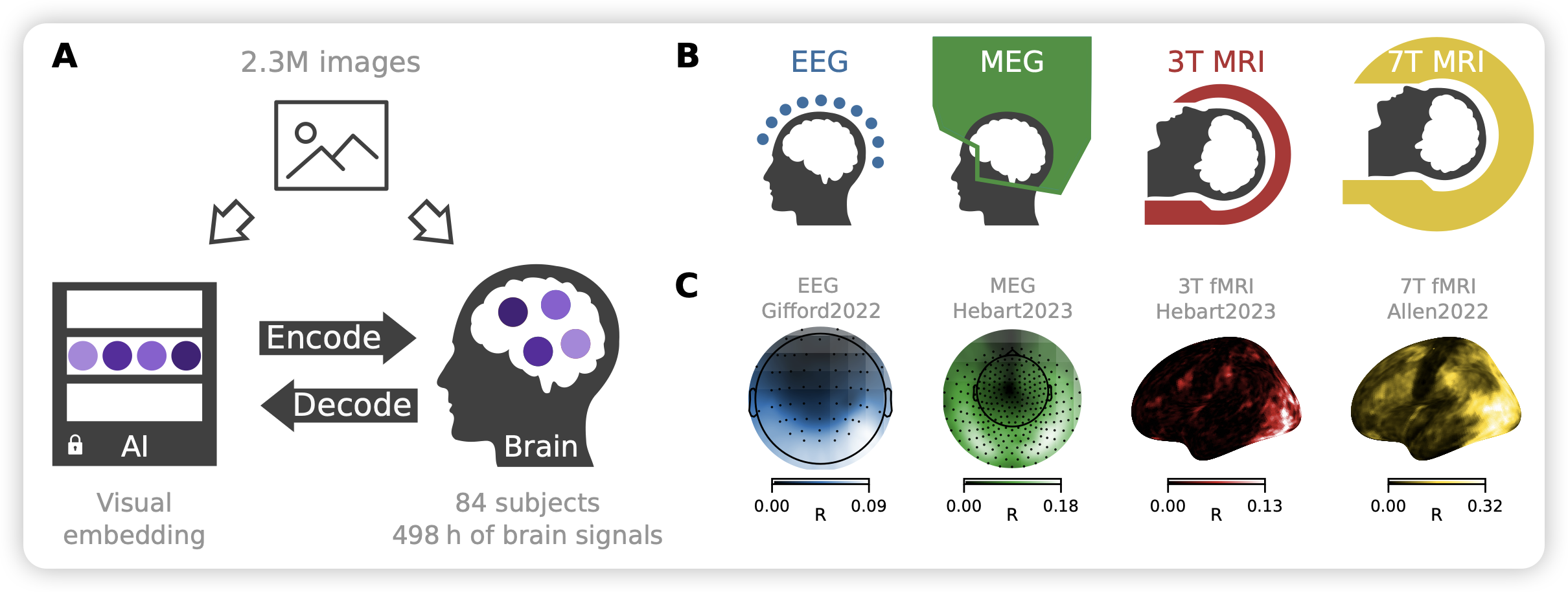

Scaling laws for decoding images from brain activity

meta的工作,感觉还是挺系统性的。作者对比了四种不同脑波解码设备的数据,用大约2.3M数据做了peer-to-peer的对比,发现:

- deep learning的方法,在数据含有噪声的情况下尤其有用

- 脑波解码领域可以画出scaling law曲线,而且在2.3M这个阶段仍然没有观察到收敛。这个很重要,说明大家可以投资去标注230M数据了

- 四种设备里,精确度最高的EEG相对表现最好

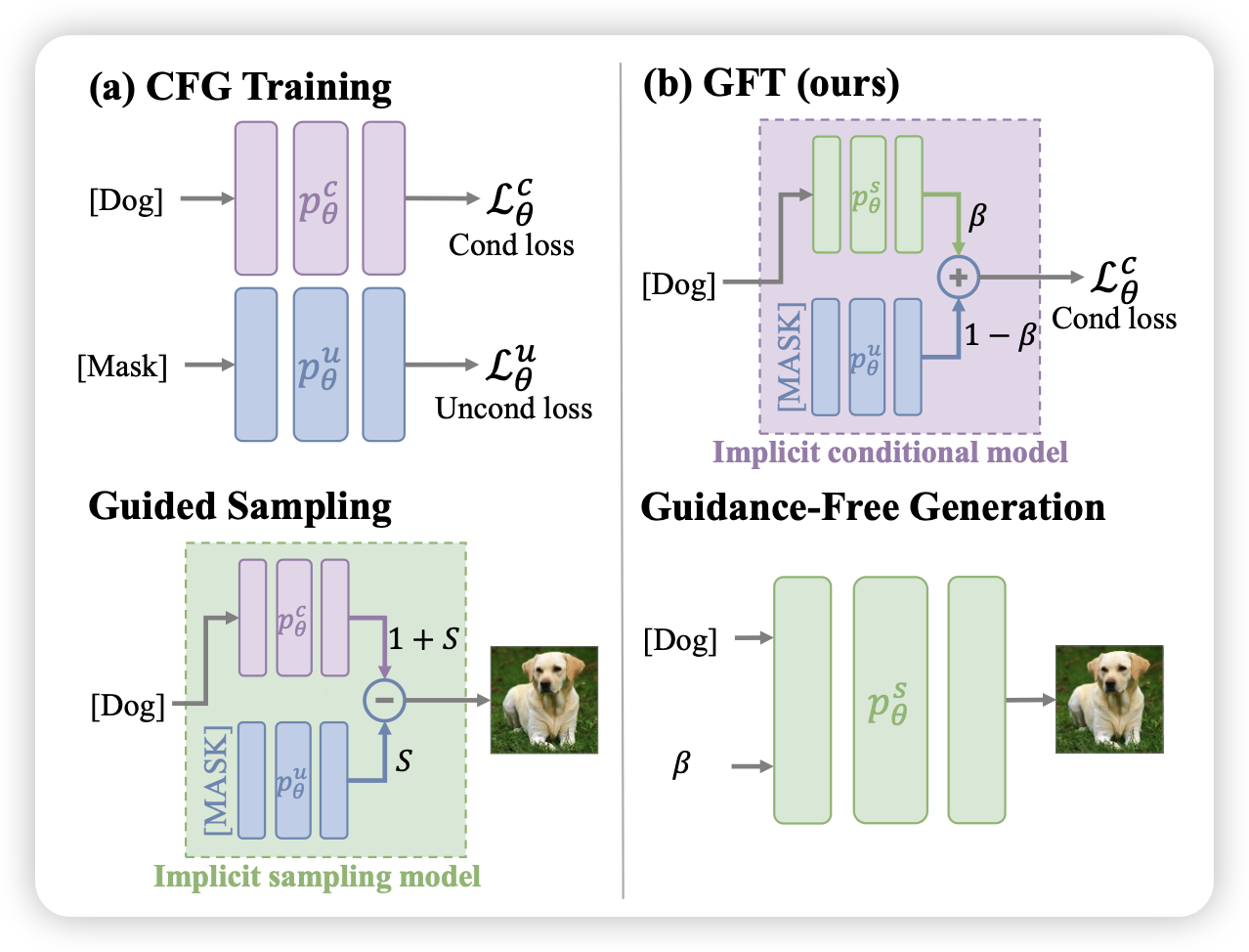

Visual Generation Without Guidance

zhujun老师的工作,之前diffusion model能火起来,应该说classifier guidance功不可没。就是说在生成狗的时候,每一步的中间状态,都有一个classifier给出是不是狗的一个信心值,这个信心值是可以求导回到中间过程中的,在生成的时候把这个梯度实时融入进去,就可以生成看起来特别像狗的照片。这篇工作说的是,能不能把这个classifier引入到训练中来,这样在推理的时候可以不依靠classifier一直在线了呢?