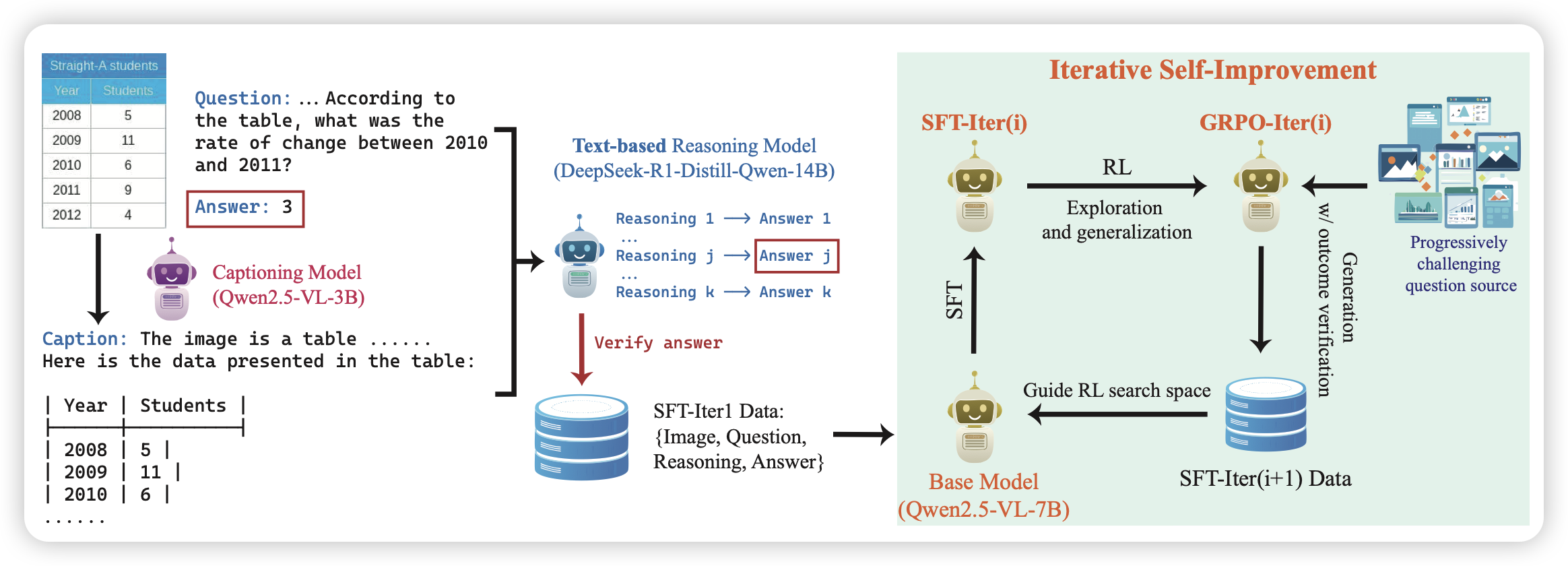

OpenVLThinker: An Early Exploration to Complex Vision-Language Reasoning via Iterative Self-Improvement

这篇文章探索了VLM o1的路线,但是这个路线还挺好玩的。大家还记得llm刚出来的时候,大家是怎么合成vlm sft数据的吗?就是给个图片caption,然后让llm对着caption想qa对。作者在o1里做了这个,让r1对着caption想qa对,然后训回去。

所以世界是一个大的循环……这么说neubig做得那一大堆改进得论文,都能搞出来vl-o1的版本了